コンピュータと思考

コンピュータと脳

きっかけはコンピュータと脳の類似性ついてのジェフ・ラスキンの指摘を読んだことでした。

遠い昔から、思想家が人間理解のためのモデルとして拝借してきた最新技術というものは、技術の進歩にともなって放棄されるか、モデルに制約を課してしまうかのいずれかであったことを考えると、こういったアプローチには懐疑的にならざるを得ません。(中略)17世紀には、世界とその住人はゼンマイ仕掛けにしばしば喩えられていました。(中略)また19世紀には、蒸気機関のメタファによって、人体の機能に関する多くの哲学的思索が浸透しました。(中略)機能的な類似を示す直接的な証拠が出てこない限り、脳をコンピュータに喩えるメタファは避けた方が賢明と言えるわけです。

ジェフ・ラスキン「ヒューメイン・インターフェース」

たしかにコンピュータはパワフルで現在でもなお未知の力を秘めているため、現代人にとっての「ゼンマイ仕掛け」かもしれません。ついつい脳と重ね合わせたくなりますので、この冷静な指摘は価値があります。

考えるためのコンピュータ

ラスキンにならいコンピュータと脳の類似性は脳の専門家にまかせるとして、一方でこんなことが頭の中から湧き上がってきました。

「人間は考えるためにコンピュータを使う。考えてからではなく考えるために。」

これは私がタスクベースUI との対比でオブジェクトベースUIの特徴を言い表そうとして考えていたことでした。

タスクベース UIというのは人間がタスク(すること)を先に決めていることを前提にしています。しかもユーザーとコンピュータの間でそのタスクが同じタスク名として認識されているということが前提になります。(そうでなければタスクを適切に選択できません。)

これはどうも無理があると感じていて、むしろ人間はタスクを明確に考えずに操作することを前提にする必要があると思っていました。「タスク(すること)」が真に明らかになるのはそれを成した後だけなのです。

タスクという塊になる前の思考中のイメージをそのままコンピュータで扱えることを目指すのがGUIです。人間がりんごを想起しているならばコンピュータ上にりんごを表示させるといった具合です。

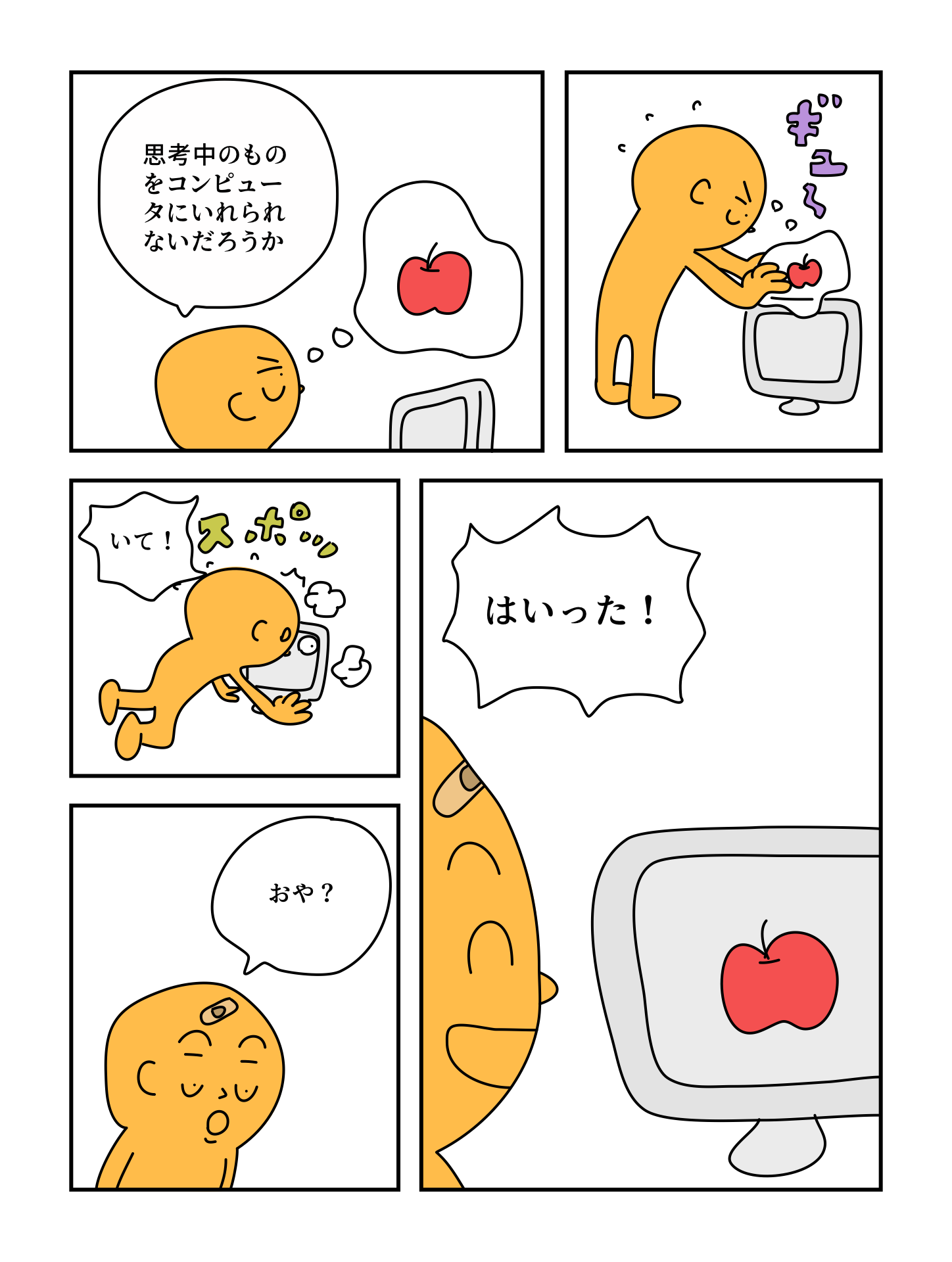

コンピュータに頭で浮かんだりんごを吹き出しごと手で押し込む。

「いてっ」スポッとコンピュータに入りその勢いで頭をぶつける。

「おや?」おでこに絆創膏。

「はいった!」コンピュータの画面にりんごが表示されている。

この場合コンピュータの中の世界は現実世界の延長とも言えますし、現実世界を元にシンボルとして抽象化した世界とも言えるでしょう。

いずれにしても「思考の拡張という意味でコンピュータが思考に寄せて作られる」と言えるかもしれません。その結果として、脳、というよりも人間の思考がコンピュータに似ているように見えてもおかしくはありません。

同時進行する思考と行動

さて、話はもう一歩進みます。

ここまではまるで思考が先にありコンピュータがそれを模倣して、思考の中にしかなかった概念を現実のGUI上で操作できるようにするという話でした。

頭の中でりんごを想起しているならば、コンピュータのGUIに抽象化されたりんごを写し出す。それをユーザーが操作できるようにする、という話です。

では、コンピュータと人間が向き合っている状態をイメージして時計の針を1分いや15秒でも進めてみましょう。

人間は頭の中にあったものをGUI上に発見して、何か思うことがあるでしょう。果物の赤さを知ったり、重さが書いてあれば重さを知ります。コンピュータ上で半分に割るシミュレーションができるならば中はこんなになっているのかと考えることもあります。

ここで人間は思考と行動がほぼ同時に進行しています。ただし、これはコンピュータ特有のことではありません。日常生活においてもよく行われていることです。

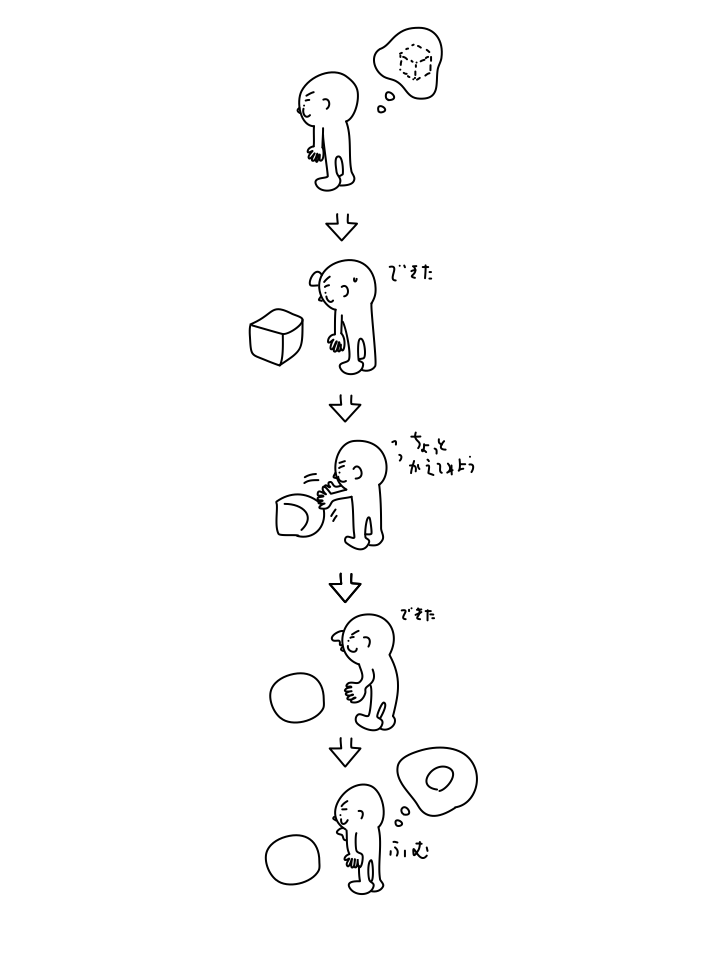

私は白紙に絵を描くときに、頭の中でイメージを思い浮かべて描き始めますが、その一方で描きながらイメージを変化させることも多いのです。というかほとんどそうです。

1つ1つの線を細部までイメージしきってから描くのはとても難しいことです。だから描いた絵を見てまた考えます。いや、描きながら同時に考えているのでしょう。

さて、その際に紙やペンの具合によって絵が変わることがあります。絵が変わるということは同時に考えていることも変わっています。つまり紙やペンの具合によって思考が変わってきていると言えます。

絵をあまり描かない人でも文章を書くときに同じことをしています。文章を書く行為は、思考を線形に変換する作業です。思考は線形に展開するわけではありませんので先に一言一句完全な文面をイメージしてから書くのはとても難しいことです。

コンピュータの話に戻しましょう。

紙やペンをコンピュータに置き換えてみるとコンピュータの特徴が思考になんらかの影響を及ぼすことがあると考えるのが自然です。紙で考えるのかブロックで考えるのかコンピュータで考えるのか、それぞれ特性があり思考は変わってくるはずです。

それぞれの特性から乱暴に単純化すれば紙であれば平面的に、ブロックであれば立体的に、コンピュータであればデータベース的に考えるようになります。

最初の話に戻れば、

- コンピュータは人間の思考に寄せて作られる。

- 使う人間の思考もコンピュータの特徴に影響を受ける。

この2点においてコンピュータと人間の思考が似ていると考える人がいても不思議ではありません。

オブジェクトベースUIの世界観

ユーザーモデリングなどで人間は何か目的を明確に持っていて、その目的に応じた「タスク(すること)」を抱えていると定義しがちです。しかしこういった人間の捉え方をしてしまうとタスクベース UIが出来上がってしまいます。

隣り合った線路を並走する2つの電車のように思考と行動はほんのわずかに抜きつ抜かれつしながら(つまりほぼ同時に)行われます。このことを前提に人間を捉えることでタスクではなくオブジェクトを先に見せるオブジェクトベースUIの世界観のイメージがつかめるようになるかもしれません。

メンタルモデル

「ユーザーが持っているモデル」という言い方がありますが、ユーザーはモデルを持っている場合もあれば持っていない場合もあります。持つといってもおぼろげながら持つといったほうが正確かもしれません。つまりユーザーが持つモデルに合わせるといってもユーザーに聞いてもわからないこともあるということです。デザイナーに提示されたモデルを見てユーザーはモデルを得ます。(絵の場合は自ら描くことでモデルを得ます。)